ドワンゴがディープラーニングを用いたアニメの中割り実験の結果を公開しました。

原画を直接中割りするまでには至らなかったものの、動画の枚数を増やすことには部分的に成功。

スローモーション演出などへの利用に可能性があるとしています。

動画

https://www.youtube.com/watch?v=_RM1zUrY1AQ

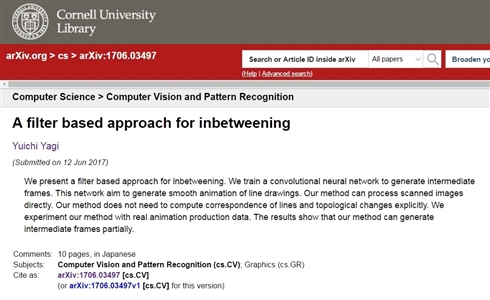

同手法は、早稲田大学の研究チームが2016年に提案したラフスケッチの自動線画化手法(関連記事)を出発点とし、中割りができるよう変更を加えたもの。

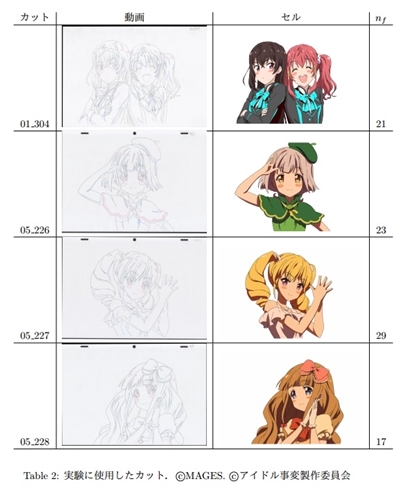

アニメ「アイドル事変」の製作委員会やMAGES.協力の下、実際の動画とセルのデータを使用し、実験により自動生成された映像はYouTubeに投稿、実験結果をまとめた論文はコーネル大学図書館が運営する「arXiv(アーカイヴ)」上で公開されています。

アニメ「アイドル事変」公式 @idol_jihen

\総理!私達、ニッポンのアニメ業界を笑顔にしたいんです!/

ドワンゴが行っている<deep learningを使った中割の実験>に、

『アイドル事変』が協力させていただきました♪

AI技術で2Dアニメーションを滑らかにする研究です

https://twitter.com/idol_jihen/status/874886607765213184

※「アイドル事変」全面協力

「中割り」とは原画と原画の間を補完する動きを描いた絵のこと。

「動画」は「中割り+原画をトレースした絵」のことを言います。

実験では動画枚数が約4倍になるよう設定されており、比較映像では元の映像よりも「ぬるぬる」動いていることが確認できます。

ただし精度にはむらがあるようで、動きの途中でキャラクターの手が消滅したり、身体のパーツが曲がってしまうなど、改善の余地はまだまだありそうです。

Yuichi Yagi? @yuichiyagi

ドワンゴでdeep learningを使った中割の実験を行いました。

原画の中割は出来ませんが動画の枚数を増やす事は部分的には出来ました。

アイドル事変のデータを使用させて頂きました。

https://twitter.com/yuichiyagi/status/874876677201031169

※論文を執筆したドワンゴのヤギ ユウイチさんがツイートで告知

同手法では低解像度ネットワークと高解像度ネットワークで構成されおり、2枚の線画を入力することで中間的な線画を1枚出力するという仕組み。

今回は機械学習をカットごとに行ったため、今後は大量のカットを学習させ、未知のカットに対して処理をすることが課題になるとのこと。

論文では同実験の結果について、「原画を直接中割りすることは無理だと思われるため動画工程の省力化には寄与しそうにない」としつつも、

「秒24枚以上のアニメーションを制作する場合やスローモーションを作る場合には役立つ可能性はある」と結論付けています。

いわゆる「ぬるぬる」した動きやスロー演出を行うには大量の中割りが必要となりますが、そうしたスペシャルなカットが比較的容易に作れるようになる日が来るのかもしれません。

MitsuoIso @IsoMitsuo

アニメ業界がAIにやってほしいことは色々あるのだがどこに言えばいいのかわからん

https://twitter.com/IsoMitsuo/status/874925188168679424

※「電脳コイル」監督の磯光雄さんも反応しています

>原画を直接中割りすることは無理だと思われるため動画工程の省力化には寄与しそうにない

1年後にGoogleがあっさり実現というオチじゃないか

既に一枚の写真から立体を生成する技術が進んでるからGoogleやデイズニーのほうが

早いかもね

宮崎監督へのプレゼンはみんな唖然

雪とか滝とかでいいじゃん、なにが悲しくてゾンビでプレゼンなんだと

描く枚数を減らせる=労働力の削減 に繋がるっちゅうことか?

リミテッドアニメ(8枚)をフルアニメーション(24枚)にするような感じじゃないか?

原画を描いたら自動的に中割をするようなことにはならないと思う。

そこまで行くには、演算能力の向上と膨大なディープラーニングが求められるだろうな。

これ以上はコンピューターがになにを自分が描いてるか

構造を立体でなおかつだいたいの重さや仕組みまで把握してないと無理だと思う

そこで自己認識AIですよw

バリが取れてない感じ

ただアイドル事変くらいなら全部3Dでいいんじゃないか?

「闇芝居」ってアニメもあるのにw

またGoogleが力技でなんとかしそう

[amazonjs asin="4532113717" locale="JP" title="AI(人工知能)まるわかり (日経文庫)"]

引用元:http://egg.2ch.sc/test/read.cgi/moeplus/1497511195/